Juridische aspecten (Legal aspects) rond Generative AI

Generative AI, een technologie die zelfstandig nieuwe content en oplossingen kan creëren, brengt ingrijpende juridische uitdagingen met zich mee. Terwijl deze technologie nieuwe mogelijkheden opent, dwingt het ons ook om opnieuw na te denken over verantwoordelijkheid, auteursrechten, privacy en aansprakelijkheid.

Wie is verantwoordelijkheid voor de output?

Kenniswerkers, zoals advocaten, onderzoekers, marketeers en ingenieurs, zien hun werkzaamheden veranderen door de integratie van generative AI en deze verandering brengt complexe juridische kwesties met zich mee. Een van de belangrijkste vragen is wie juridisch verantwoordelijk is voor door AI gegenereerde output. Wanneer een AI-systeem bijvoorbeeld juridische documenten opstelt of wetenschappelijk onderzoek uitvoert, wie draagt dan de verantwoordelijkheid voor fouten of misleidende informatie?

Transparantie m.b.t. aansprakelijkheid is cruciaal, vooral in sectoren waar beslissingen op basis van AI directe gevolgen hebben voor mensenlevens of eigendommen. In de advocatuur bijvoorbeeld, kunnen fouten in door AI gegenereerde juridische documenten leiden tot rechtszaken en aanzienlijke schadeclaims. Het is noodzakelijk dat de juridische gemeenschap duidelijke richtlijnen ontwikkelt voor het gebruik van AI in juridisch werk, inclusief mechanismen voor aansprakelijkheid en verantwoording.

Daarnaast rijst de kwestie van ethische verantwoordelijkheid. Kenniswerkers die AI gebruiken, moeten zich bewust zijn van de beperkingen en biases van deze technologie. Ze moeten ervoor zorgen dat AI niet wordt gebruikt op een manier die leidt tot onrechtvaardigheid of discriminatie. Dit vraagt om een juridisch kader dat richtlijnen biedt voor ethisch gebruik en dat mogelijkheden schept voor juridische recourse wanneer deze richtlijnen worden overtreden.

Europeesche AI act

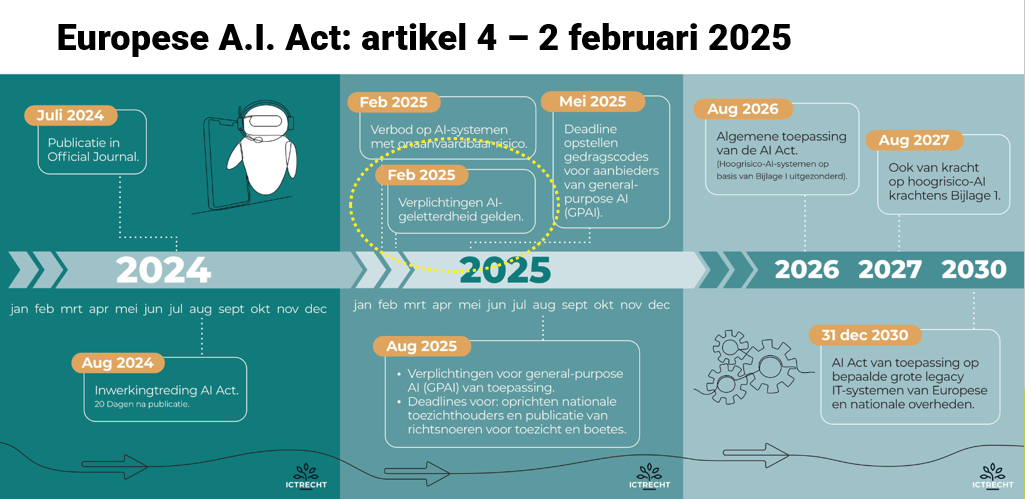

Met ingang van 1 augustus 2024 is de Europese AI Act officieel in werking getreden. Deze wetgeving is ontworpen om de voorwaarden te reguleren waaronder kunstmatige intelligentie (AI) binnen de Europese Unie mag worden toegepast. Het is nu essentieel voor organisaties om te beginnen met de implementatie van de AI Act om te zorgen dat zij voldoen aan de gestelde eisen.

De AI Act: Een Overzicht

De AI Act is een belangrijke stap van de Europese Unie om haar burgers te beschermen tegen de potentiële negatieve gevolgen van AI. AI kan, wanneer het verkeerd wordt ingezet, aanzienlijke schade toebrengen, zoals discriminatie op basis van gezichtskenmerken of manipulatie van het publieke debat. De AI Act heeft tot doel dergelijke praktijken te voorkomen door AI-toepassingen in verschillende risicocategorieën in te delen en per categorie specifieke verplichtingen en verboden vast te stellen

.Bekijk hier de volledige tekst van de European AI Act.

AI Geletterdheid

Dit is de tijdlijn voor de invoering van de Europese AI Act:

Wat is A.I. geletterdheid?

Risicocategorieën volgens de AI Act

De AI Act onderscheidt vier risicocategorieën:

- Onacceptabel risico: Deze AI-systemen vormen een directe bedreiging voor de rechten en vrijheden van burgers en zijn daarom verboden. Een voorbeeld hiervan is social scoring op basis van persoonlijke financiële gegevens.

- Hoog risico: Dit betreft AI-systemen die een aanzienlijke impact kunnen hebben op de rechten, veiligheid of gezondheid van mensen. Het gebruik van deze systemen is alleen toegestaan onder strikte voorwaarden, zoals menselijk toezicht. Voorbeelden zijn AI-systemen die worden gebruikt bij sollicitatieprocedures.

- Beperkt risico: Deze categorie omvat AI-toepassingen die mogelijk misleidend kunnen zijn, zoals chatbots die zich voordoen als mensen. Deze AI is toegestaan, mits gebruikers duidelijk worden geïnformeerd dat zij met een AI-systeem te maken hebben.

- Minimaal risico: Deze AI-systemen vormen geen of slechts een minimaal risico en zijn vrijgesteld van strenge regulering. Voorbeelden hiervan zijn spamfilters in e-mailprogramma’s.

Uitvoering van de AI Act

Hoewel de AI Act bij invoering een theoretisch kader biedt, zal de praktische implementatie in de loop van de tijd vorm krijgen door middel van jurisprudentie en aanvullende regelgeving. De EU zal aanvankelijk soepel handhaven, maar de regelgeving zal mettertijd strenger worden. Organisaties moeten zich voorbereiden op audits en boetes die kunnen oplopen tot 35 miljoen euro of 7 procent van de jaaromzet, afhankelijk van de ernst van de overtreding.

Implementatie: de eerste stappen

Voor organisaties is het nu tijd om actie te ondernemen:

- Inventariseer AI-systemen: Breng alle AI-toepassingen in kaart en bepaal tot welke risicocategorie ze behoren.

- Risicobeoordeling en compliance: Voer een risicobeoordeling uit voor hoogrisico-AI en zorg ervoor dat deze systemen voldoen aan de vereiste veiligheids- en transparantie-eisen.

- Uitfasering van verboden AI: Identificeer AI-systemen die onder de categorie “onacceptabel risico” vallen en faseer deze uit vóór 1 februari 2025.

- Documentatie en monitoring: Leg vast hoe elk AI-systeem wordt gebruikt en zorg voor voortdurende monitoring om naleving van de AI Act te waarborgen.

De gefaseerde implementatie van de AI Act biedt organisaties de tijd om zich aan te passen, maar het is cruciaal om nu te beginnen met de voorbereidingen. Door de juiste stappen te nemen en te voldoen aan de wetgeving, kunnen organisaties niet alleen boetes vermijden, maar ook bijdragen aan een ethisch verantwoorde en veilige inzet van AI binnen de Europese Unie.

Creativiteit en innovatie: IP en auteursrecht

Generative AI biedt enorme kansen voor creativiteit en innovatie, maar het roept ook complexe juridische vragen op met betrekking tot auteursrecht en intellectuele eigendomsrechten (IP). Wanneer AI bijvoorbeeld een origineel kunstwerk, ontwerp of tekst creëert, wie bezit dan de auteursrechten? Het huidige auteursrechtelijke kader is voornamelijk ontworpen voor menselijke creativiteit en past niet goed op scenario’s waarin AI de creatieve kracht is.

Er zijn verschillende juridische benaderingen om dit probleem aan te pakken. Een mogelijkheid is dat de rechten worden toegekend aan de eigenaar van het AI-systeem, vergelijkbaar met hoe auteursrechten worden toegekend aan bedrijven wanneer werknemers in loondienst creatieve werken produceren. Een andere optie is het ontwikkelen van nieuwe juridische categorieën die specifiek gericht zijn op door AI gegenereerde content.

Daarnaast is er het probleem van inbreuk op bestaande rechten. AI-modellen worden getraind op enorme hoeveelheden data, waaronder auteursrechtelijk beschermde werken. Het gebruik van deze werken zonder toestemming kan leiden tot schendingen van het auteursrecht, wat juridische complicaties veroorzaakt voor zowel de ontwikkelaars van AI-systemen als de gebruikers ervan. Dit benadrukt de noodzaak voor juridische duidelijkheid en nieuwe regelgeving die rekening houdt met de unieke uitdagingen van AI.

Onderwijs

In het onderwijs roept het gebruik van generative AI verschillende juridische vragen op, met name rond plagiaat, academische eerlijkheid en privacy. AI-systemen kunnen bijvoorbeeld essays genereren die moeilijk te onderscheiden zijn van door mensen geschreven werk, wat het risico op academisch bedrog verhoogt. Onderwijsinstellingen moeten daarom hun regels en procedures herzien om te waarborgen dat studenten eerlijk worden beoordeeld.

Een ander belangrijk juridisch aspect is de privacy van studenten. AI-tools die worden gebruikt voor gepersonaliseerd leren, verzamelen vaak grote hoeveelheden persoonlijke gegevens om leerstijlen en prestaties te analyseren. Dit brengt risico’s met zich mee met betrekking tot de bescherming van persoonlijke informatie en de naleving van privacywetgeving, zoals de Algemene Verordening Gegevensbescherming (AVG) in Europa. Onderwijsinstellingen moeten ervoor zorgen dat AI-tools voldoen aan de geldende privacyregels en dat studenten worden beschermd tegen misbruik van hun gegevens.

Verder moeten onderwijsinstellingen duidelijk zijn over de rechten van studenten met betrekking tot door AI gegenereerd werk. Wie bezit de rechten op een werkstuk dat gedeeltelijk door een AI is geschreven? Moet AI-gebruik worden aangegeven bij het indienen van academisch werk? Deze vragen vereisen juridische duidelijkheid om de integriteit van het onderwijs te waarborgen.

Maakindustrie

De maakindustrie wordt ook geconfronteerd met belangrijke juridische uitdagingen door de integratie van generative AI. AI kan bijvoorbeeld worden gebruikt om nieuwe productontwerpen te genereren en productieprocessen te optimaliseren.

Een belangrijk punt is de aansprakelijkheid voor door AI gegenereerde ontwerpen en productieprocessen. Als een AI-systeem een ontwerp maakt dat defect blijkt te zijn of leidt tot gevaarlijke producten, wie is dan verantwoordelijk? Moet de fabrikant aansprakelijk worden gesteld, de ontwikkelaar van het AI-systeem, of beide? Dit vereist een nieuw juridisch kader dat rekening houdt met de complexiteit van AI-gedreven processen.

Daarnaast zijn er juridische implicaties met betrekking tot intellectuele eigendomsrechten in de maakindustrie. Net als in creatieve sectoren, kan het onduidelijk zijn wie de rechten bezit op door AI gegenereerde ontwerpen of processen. Dit kan leiden tot juridische geschillen over eigendom en de commerciële exploitatie van deze ontwerpen.

Verder moet de maakindustrie rekening houden met de regelgeving rondom gegevensbescherming, vooral wanneer AI wordt gebruikt om productieprocessen te optimaliseren. Gegevens over productieprocessen kunnen gevoelige informatie bevatten die beschermd moet worden tegen misbruik. Bedrijven moeten ervoor zorgen dat hun gebruik van AI voldoet aan de geldende regelgeving op het gebied van gegevensbescherming en dat zij adequaat omgaan met de juridische risico’s van dataverzameling en -gebruik.

Toekomst

Generative AI brengt ingrijpende juridische uitdagingen met zich mee die vragen om een herziening van bestaande wetten en regelgeving. De snelheid waarmee AI zich ontwikkelt en wordt toegepast, betekent dat traditionele juridische kaders mogelijk niet voldoende zijn om de complexiteit en de risico’s van deze technologie aan te pakken.

Er is behoefte aan nieuwe wetten en reguleringen die specifiek zijn ontworpen om de juridische kwesties rond AI te beheren. Dit omvat richtlijnen voor aansprakelijkheid, eigendomsrechten, ethisch gebruik, en gegevensbescherming. Daarnaast moeten bestaande wetten worden aangepast om rekening te houden met de unieke uitdagingen die AI met zich meebrengt.

Internationale samenwerking zal ook cruciaal zijn, aangezien AI een wereldwijde technologie is en de juridische uitdagingen die ermee gepaard gaan grensoverschrijdend zijn. Landen moeten samenwerken om consistente juridische normen te ontwikkelen die bedrijven, kenniswerkers, en onderwijsinstellingen beschermen, terwijl ze innovatie stimuleren.

Overzicht AI gerelateerde regelgeving en richtlijnen

Hier zijn enkele van de belangrijkste Europese wetten en richtlijnen die een raakvlak met AI heben:

- GDPR (General Data Protection Regulation):

- De GDPR (AVG in het Nederlands) is de strengste privacy- en beveiligingswet ter wereld. Het legt verplichtingen op aan organisaties die gegevens verzamelen of richten op mensen in de EU. Deze wet trad in werking op 25 mei 2018 en heeft tot doel de gegevensprivacy voor EU-burgers te verbeteren.

- Meer informatie over GDPR.

- CSRD (Corporate Sustainability Reporting Directive):

- De CSRD is een EU-richtlijn die in december 2022 is vastgesteld. Het vereist dat grote bedrijven (en hun toeleveringsketen) rapporteren over hun klimaatimpact, milieurisico’s, maatschappelijke verantwoordelijkheid en governance. Hoewel het geen duurzaamheidsnormen vaststelt, verplicht het tot transparante rapportage over deze aspecten.

- Lees meer over CSRD.

- WAG 2 (Web Accessibility Guidelines 2.0):

- De WAG 2 biedt richtlijnen voor het creëren van toegankelijke webinhoud, met het oog op inclusiviteit voor mensen met een handicap. Het behandelt ontwerp, codering en multimedia-elementen om de toegankelijkheid van websites te verbeteren.

- Lees de WAG 2-richtlijnen.